Project Maven, cos’è il programma di intelligenza artificiale del Pentagono che cambia la guerra moderna

Project Maven non è più solo un software che aiuta ad analizzare immagini dei droni. Oggi è uno dei programmi di IA militare più importanti del Pentagono, perché accelera il passaggio dalla raccolta delle informazioni alla scelta del bersaglio e all’azione operativa. Nato nel 2017 come progetto per leggere più in fretta enormi quantità di video e dati, nel tempo si è evoluto in una piattaforma molto più ampia di supporto al comando e al targeting.

In altre parole, la domanda implicita del lettore è semplice: che cosa fa davvero Project Maven e perché conta adesso?

La risposta è questa: riduce drasticamente i tempi decisionali sul campo, integra fonti informative diverse e rende più rapida la cosiddetta kill chain, cioè la sequenza che porta dall’individuazione di una minaccia alla sua neutralizzazione. È qui che si misura una delle trasformazioni più profonde della guerra contemporanea.

Cos’è Project Maven

Project Maven è il programma di punta del Dipartimento della Difesa americano sull’uso operativo dell’intelligenza artificiale. Il Pentagono lo avviò nell’aprile 2017 con l’obiettivo iniziale di aiutare analisti militari e civili a gestire il volume enorme di filmati full-motion video, immagini satellitari e altri dati raccolti nelle operazioni.

Il primo compito del sistema era relativamente circoscritto: usare algoritmi di computer vision per riconoscere oggetti, movimenti e pattern rilevanti all’interno di flussi video troppo vasti per essere esaminati in modo efficiente solo da operatori umani. In sostanza, trovare in pochi secondi ciò che prima richiedeva ore.

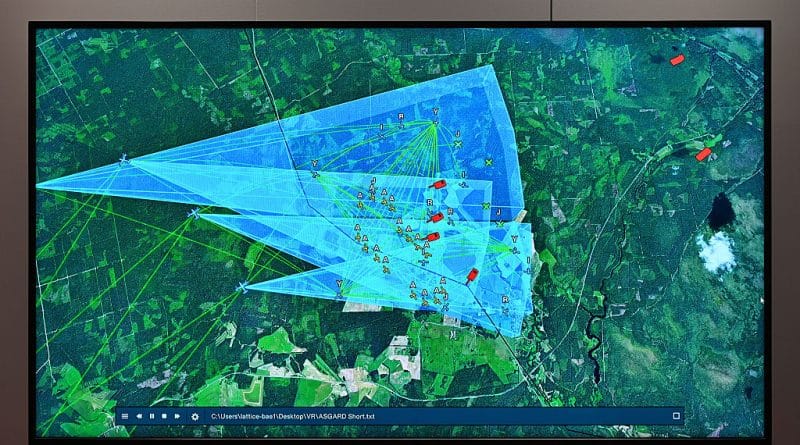

Con il tempo, però, il progetto è uscito da quella fase sperimentale. Oggi Maven viene descritto sempre più spesso come una base software capace di fondere intelligence, immagini, dati dei sensori e quadro operativo, offrendo ai comandanti una visione più rapida e leggibile del teatro di guerra.

Come funziona Project Maven

Il principio è semplice solo in apparenza. Maven raccoglie e collega informazioni provenienti da fonti diverse: droni, satelliti, sensori, immagini, flussi video e dati d’intelligence. L’IA aiuta poi a classificare, evidenziare e ordinare ciò che conta davvero, così da supportare la decisione operativa. (defense.gov)

Questo significa, sul piano pratico, tre cose.

La prima: individuare più in fretta movimenti sospetti, mezzi, strutture o persone di interesse.

La seconda: ridurre il carico cognitivo degli analisti, che non devono più passare tutto il materiale fotogramma per fotogramma.

La terza: presentare ai decisori un quadro sintetico, aggiornato e operativo in tempi molto più brevi rispetto ai processi tradizionali.

È proprio qui che entra in gioco il concetto di accelerazione della kill chain. In ambito militare, comprimere i tempi tra identificazione del bersaglio, valutazione e ingaggio può fare la differenza tra un’opportunità colta e una persa. Per questo Project Maven è considerato un passaggio chiave nell’evoluzione della guerra assistita da algoritmi.

Perché Project Maven è diventato così importante

Il punto non è solo tecnologico. È strategico.

Negli ultimi anni le forze armate hanno dovuto gestire una quantità crescente di dati provenienti dal campo: video, geolocalizzazione, segnali, immagini satellitari, telemetrie. Senza strumenti avanzati, quel volume rischia di rallentare proprio chi dovrebbe decidere più rapidamente. Maven nasce per risolvere questo collo di bottiglia.

Per il Pentagono, quindi, l’IA non è soltanto un supporto tecnico. È un moltiplicatore di velocità, coordinamento e capacità decisionale. Ed è per questo che il progetto, partito come iniziativa specialistica, è diventato una piattaforma centrale nella trasformazione digitale della difesa americana.

Il caso Google: perché disse no

Nelle prime fasi del progetto, Google fu coinvolta come contractor tecnologico. Ma nel 2018 il rapporto diventò un caso globale dentro e fuori Silicon Valley. Più di 3.000 dipendenti firmarono una lettera di protesta contro il coinvolgimento dell’azienda in Maven, sostenendo che l’uso dell’IA in ambito militare avesse superato una soglia etica critica.

Alla scadenza del contratto, Google decise di non proseguire e pubblicò principi interni sull’intelligenza artificiale che escludevano il supporto a sistemi d’arma “weaponized”. Quella scelta rese evidente una frattura profonda: da un lato chi riteneva il targeting automatizzato una linea rossa, dall’altro chi lo considerava inevitabile nel contesto della competizione strategica.

Il tema, però, non si è mai davvero chiuso. Negli anni successivi il rapporto fra Big Tech e difesa è tornato a intensificarsi, e lo stesso ecosistema industriale americano ha mostrato una crescente disponibilità a lavorare su programmi di sicurezza nazionale. Su questo terreno, Maven è diventato uno dei dossier più simbolici.

Il ruolo di Palantir

Dopo la stagione delle polemiche su Google, il nome che più si è legato a Project Maven è Palantir. Secondo fonti di settore, nel 2024 il Dipartimento della Difesa ha assegnato a Palantir un contratto iniziale quinquennale da 480 milioni di dollari per il Maven Smart System, poi ampliato nel 2025 con un forte aumento del tetto complessivo, oltre il miliardo di dollari.

Questo passaggio è importante perché segnala che Maven non è più visto come un progetto accessorio, ma come una capacità operativa in espansione, destinata a essere usata da un numero crescente di comandi e unità militari. In termini industriali, significa anche che il software militare basato su IA è ormai un segmento centrale della spesa strategica americana.

Anthropic, Claude e i limiti sull’uso militare dell’IA

Un altro tassello riguarda i modelli linguistici. Anthropic ha annunciato nel 2025 un accordo da 200 milioni di dollari con il Dipartimento della Difesa per capacità di IA, incluse soluzioni Claude destinate a usi governativi e di difesa.

Più di recente, però, Anthropic ha dichiarato pubblicamente che le trattative con l’amministrazione americana si sono bloccate su due eccezioni che la società chiedeva di escludere: sorveglianza domestica di massa sugli americani e armi completamente autonome. L’azienda ha spiegato che questo stallo ha portato alla rottura sul punto.

Questo dettaglio conta molto perché mostra dove si sta spostando il dibattito reale: non più soltanto “IA sì o no”, ma quali limiti operativi, legali ed etici imporre quando questi sistemi entrano nei processi militari e decisionali.

Cosa cambia nella guerra moderna

L’aspetto decisivo è che Project Maven rappresenta un cambio di paradigma. Nelle guerre del passato recente, il vantaggio dipendeva spesso dalla superiorità di mezzi o fuoco. Nella fase attuale conta sempre di più la capacità di vedere prima, capire prima e colpire prima.

L’intelligenza artificiale applicata al campo di battaglia sposta il baricentro verso la velocità dell’informazione. Chi riesce a fondere dati, individuare pattern e trasformare segnali dispersi in decisioni operative coerenti ottiene un vantaggio immediato. Project Maven si colloca esattamente in questo snodo.

I nodi aperti: affidabilità, responsabilità, controllo umano

Proprio perché il programma è così potente, restano aperte questioni centrali.

La prima è l’affidabilità: ogni sistema di IA può sbagliare classificazione, attribuzione o priorità se i dati sono incompleti, distorti o male interpretati. La seconda è la responsabilità: quando una macchina suggerisce e un essere umano approva, dove finisce davvero il confine decisionale? La terza è il controllo umano significativo, cioè il principio secondo cui l’ultima scelta sull’uso della forza non dovrebbe essere interamente automatizzata. Su questi temi il Pentagono ha sviluppato linee guida di “responsible AI”, ma il dibattito resta aperto.

Perché Project Maven va seguito da vicino

Project Maven non è soltanto un programma militare americano. È un indicatore di dove sta andando la guerra nel XXI secolo.

Dice che il software non è più un supporto marginale, ma una componente centrale della superiorità militare. Dice anche che il confine fra analisi, targeting e decisione operativa si sta restringendo. E soprattutto mostra che il tema dell’IA nella difesa non riguarda più scenari teorici: è già dentro le architetture di comando, nei contratti industriali e nelle scelte strategiche delle grandi potenze. (defense.gov)

🎥 Segui InfoDifesa anche su YouTube!

Approfondimenti, notizie, interviste esclusive e analisi sul mondo della difesa, delle forze armate e della sicurezza: iscriviti al canale ufficiale di InfoDifesa per non perdere nessun aggiornamento.

🔔 ISCRIVITI ORAUnisciti alla community di InfoDifesa: oltre 30.000 utenti già ci seguono!

📲 Unisciti al canale WhatsApp di Infodifesa!

Vuoi ricevere aggiornamenti, notizie esclusive e approfondimenti direttamente sul tuo smartphone? Iscriviti ora al nostro canale ufficiale WhatsApp!

✅ Iscriviti su WhatsAppSenza spam. Solo ciò che ti interessa davvero.